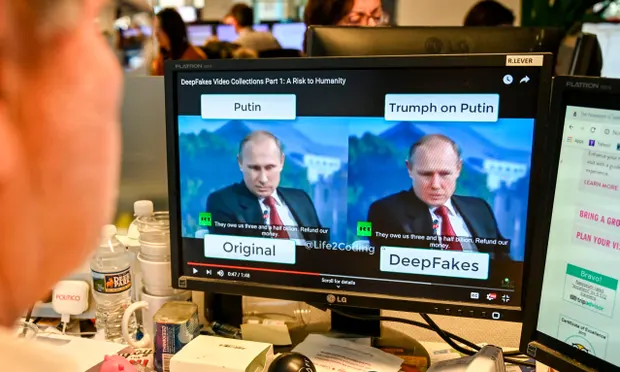

Deepfake là từ được ghép lại từ hai chữ “Deep” trong Deep-learning (học sâu) và “fake” (giả mạo). Deepfake có thể hiểu là một công nghệ trí tuệ nhân tạo tiên tiến sử dụng nhiều lớp thuật toán máy học để trích xuất dần dần các tính năng cấp cao hơn từ một đầu vào có lượng dữ liệu thô, nó có khả năng học hỏi từ dữ liệu phi cấu trúc – chẳng hạn như khuôn mặt người. Nó thậm chí có thể thu thập dữ liệu về các chuyển động vật lí của con người. Deepfake sẽ quét video và ảnh chân dung của một người sau đó hợp nhất với video riêng biệt và thay thế các chi tiết trên gương mặt như mắt, miệng, mũi với chuyển động gương mặt, giọng nói như thật. Càng có nhiều dữ liệu gốc, độ chân thực của video deepfake càng cao, đến mức gần như không thể phân biệt với video thật. Vì vậy, deepfake đã trở thành công cụ đắc lực phục vụ mục đích bất hợp pháp của các loại tội phạm công nghệ cao.

Theo thống kê của các tổ chức quốc tế, trung bình một kẻ lừa đảo thông qua deepfake đã đánh cắp từ 81.000 đến 97.000 USD trước khi vụ lừa đảo bị phanh phui và gây thiệt hại cho các tổ chức tài chính hàng tỷ USD mỗi năm. Tiêu biểu như CEO của một công ty năng lượng tại Anh bị lừa 243.000 USD chỉ bằng giọng nói deepfake của người đứng đầu công ty với yêu cầu chuyển tiền khẩn cấp. Sự giả mạo quá thuyết phục khiến CEO không kịp nghi ngờ và không nghĩ đến việc kiểm tra chéo, tiền không được chuyển đến trụ sở chính mà đến một tài khoản ngân hàng bên thứ ba. CEO chỉ trở nên nghi ngờ khi “sếp” yêu cầu thêm một đợt chuyển tiền khác.

Tại Việt Nam, theo chuyên gia tại Trung tâm Giám sát an toàn không gian mạng quốc gia cho biết, thời gian qua, Trung tâm thường xuyên nhận được báo cáo về những vụ việc lừa đảo qua videocall. Trên thực tế đã có nhiều trường hợp tại TP. Hà Nội, Thái Nguyên, Tuyên Quang bị lừa mất hàng trăm triệu đồng bởi các cuộc gọi video deepfake.

Về cách thức của thủ đoạn lợi dụng deepfake để lừa đảo chiếm đoạt tài sản: Đầu tiên, thông qua Internet, các đối tượng thu thập dữ liệu người dùng mạng xã hội như hình ảnh, video khung cảnh quen thuộc, hình ảnh và các thông tin liên quan của cá nhân. Sau đó dùng các ứng dụng, phần mềm ghép mặt, ghép nền như Reface, FaceApp, Face Swap Live, FaceArt, ZAO… tạo thành các video có khuôn mặt, giọng nói và cách xưng hô quen thuộc. Các đối tượng tiến hành chiếm đoạt tài khoản hoặc tạo lập tài khoản giả mạo mới trên mạng xã hội trùng thông tin và ảnh đại diện của người dùng; kết bạn với mọi người trong danh sách bạn bè và nhắn tin vay mượn tiền theo kịch bản đã dựng trước. Cuối cùng, để tạo lòng tin với nạn nhân, đối tượng tiến hành gọi video, khiến nạn nhân nhận ra hình ảnh và giọng nói của người quen và nhanh chóng chuyển tiền theo yêu cầu của đối tượng. Ngoài ra, các đối tượng còn lập các tài khoản ngân hàng có tên trùng với người bị giả mạo. Thủ đoạn lừa đảo mới này khiến nhiều người mất số tiền lớn vì cuộc gọi video hiện lên đúng ảnh đại diện, chủ tài khoản mở tại ngân hàng cũng trùng tên với bạn bè, người thân của mình.

Nhận diện video deepfake: Tuy deepfake có thể tạo ra video giả với độ chân thực cao nhưng hiện nay, công nghệ này vẫn chưa đạt tới mức độ hoàn hảo. Dưới đây là một số dấu hiệu nhận biết một cuộc gọi là deepfake:

- Thời gian cuộc gọi thường rất ngắn, chỉ vài giây rồi tắt máy, lấy lý do “sóng yếu, mạng chập chờn” để từ chối tiếp tục nói chuyện;

- Khuôn mặt người gọi thiếu cảm xúc và khá “trơ” khi nói; tư thế lúng túng, thiếu tự nhiên; hướng đầu và cơ thể không nhất quán với nhau; chuyển động mắt không tự nhiên…

- Các chi tiết như màu da, tóc, răng của nhân vật trong video không giống nhật, ánh sáng kỳ lạ, bóng đổ không đúng vị trí…

- Âm thanh không đồng nhất với hình ảnh, có nhiều tiếng ồn bị lạc vào video hoặc video không có âm thanh;

Cách phòng tránh với thủ đoạn lợi dụng deepfake để lừa đảo chiếm đoạt tài sản: Trước những chiêu trò lừa đảo ngày càng tinh vi hơn và không phải ai cũng có đủ kiến thức về công nghệ để nhận ra những video là giả mạo bởi deepfake. Vì vậy, người dùng Internet nói chung và mạng xã hội nói riêng cần chủ động thực hiện một số việc nhằm phòng tránh loại tội phạm này như:

Một là, tin tưởng nhưng vẫn phải xác minh: Nếu nhận được tin nhắn hoặc video với mục đích vay tiền hoặc mượn tài sản cá nhân, dù giọng nói và hình ảnh rất quen thuộc và cực kì giống thật, hãy gọi lại bằng số điện thoại của người thân để xác minh rằng đồng nghiệp, người thân đó thực sự vừa gửi tin nhắn, gọi video.

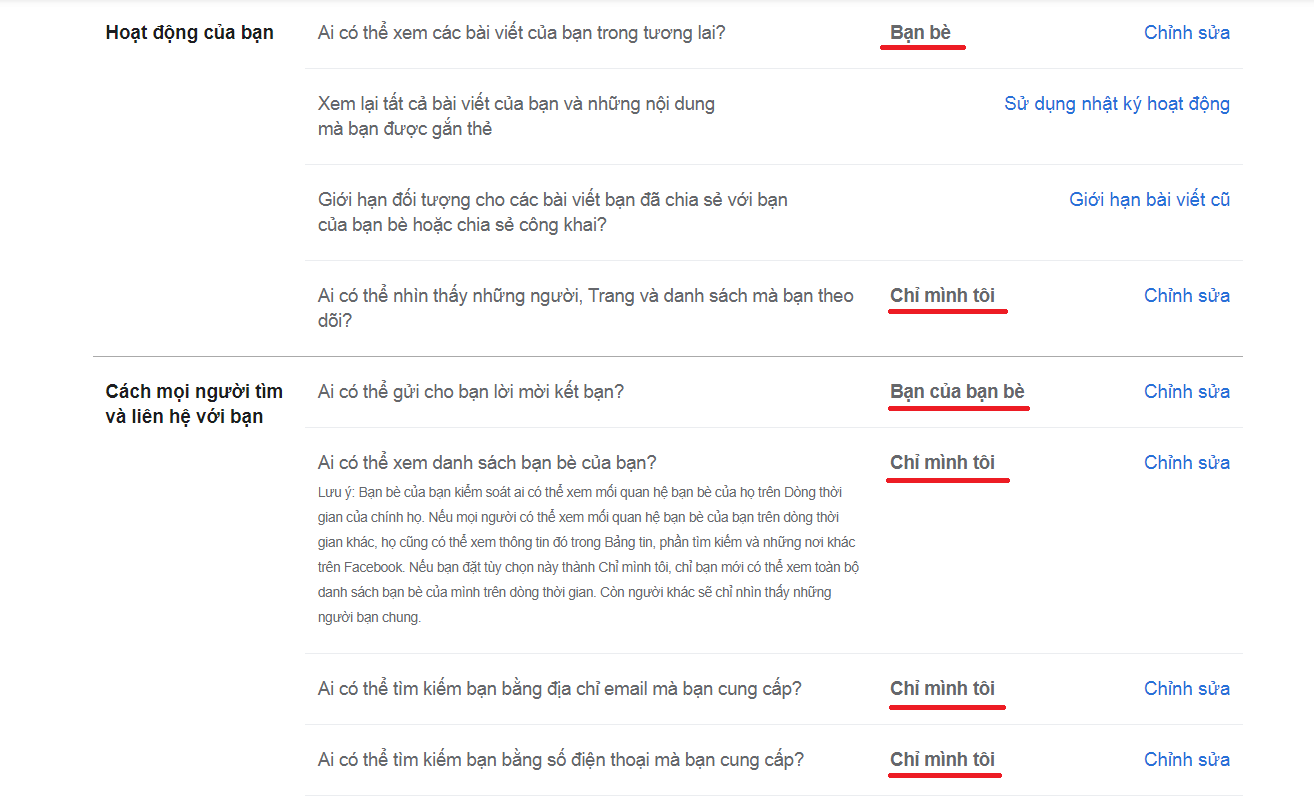

Hai là, hạn chế quyền truy cập vào tài khoản mạng xã hội: Để ngăn chặn việc dữ liệu hình ảnh, âm thanh bị sao chép, hãy hạn chế đăng tải các thông tin cá nhân lên mạng xã hội; thiết lập tài khoản ở chế độ riêng tư hoặc chỉ bạn bè; chỉ chấp nhận yêu cầu kết bạn từ những người tin tưởng; cài đặt không hiển thị danh sách bạn bè với người lạ.

Ba là, không vội truy cập bất kì đường link nào: Khi nhận được một đường link với những cấu trúc lạ, không vội vàng nhấp vào đường link/nút đó, vì rất có thể đó là một cái bẫy để các đối tượng chiếm đoạt tài khoản cá nhân.

Bốn là, chú ý vào những điều nhỏ nhất: Nếu nhận được yêu cầu với nội dung chuyển tiền, hãy xem kĩ số điện thoại, email hoặc tài khoản có trùng khớp với người đang yêu cầu chuyển tiền không. Thông thường, các đối tượng sẽ yêu cầu chuyển tiền sang một tài khoản bên thứ ba hoặc sang một tài khoản có tên gần tương tự.